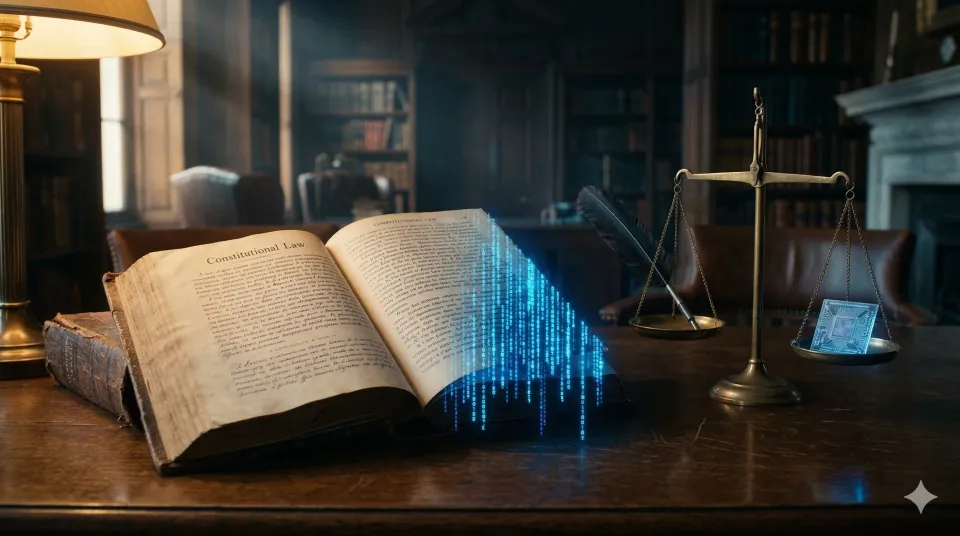

전쟁에서 AI가 사람을 죽이면 누가 책임지는가

2026년 3월, 미 국방부는 앤트로픽을 미국 기업 최초로 공급망 위험이라 지정했다. 표면적 이유는 클로드에 킬 스위치가 내장됐다는 것이었다. 앤트로픽이 클로드를 멈출 스위치로 전쟁 중에 원격 조작할 있다는 우려였다. 그러나 진짜 싸움은 그게 아니었다. 국방부가 무력화하려 한 것은 앤트로픽이 설계 단계에서 모델 안에 심어놓은 윤리적 제약, 즉 특정 명령을 거부하도록 훈련된 AI 자체였다. AI가 살상 결정에 개입할수록, 그 결정에 책임질 인간이 사라진다. 민주주의는 그 책임의 연쇄 위에 서 있다.