엔비디아 베라 루빈(Vera Rubin) 플랫폼이란 무엇인가?

엔비디아 베라 루빈은 GPU, CPU, HBM4, NVLink 6, DPU를 통합한 차세대 AI 슈퍼컴퓨팅 플랫폼입니다. 블랙웰 대비 추론 성능은 5배 향상되고, 토큰당 비용은 최대 10분의 1로 낮아집니다. 특히 HBM4는 단순 적층 증가가 아니라 인터페이스 폭을 2배 확장해 대역폭을 획기적으로 끌어올린 것이 핵심인데요, 2026년 1분기 풀 프로덕션에 진입했으며, 하반기 클라우드 상용화를 앞두고 AI 인프라 경쟁의 기준을 재정의하고 있습니다

이 글은 다음과 같은 질문에 답변을 드립니다.

- 엔비디아 베라 루빈 플랫폼의 정의와 구성은 무엇인가?

- 블랙웰과 베라 루빈의 차이점은 무엇인가?

- HBM4가 HBM3E보다 빠른 이유는 무엇인가?

- 베라 루빈은 언제 출시되는가?

- AI 추론 비용은 얼마나 낮아지는가?

엔비디아 베라 루빈(Vera Rubin)은 GPU, CPU, 메모리, 인터커넥트를 하나의 시스템으로 통합한 차세대 AI 컴퓨팅 플랫폼입니다. 엔비디아 뉴스룸(2026년 1월)에 따르면, 베라 루빈은 이전 세대인 블랙웰(Blackwell) 대비 추론 성능을 5배 향상시키고 토큰당 비용을 10분의 1로 낮춥니다. 엔비디아는 CES 2026에서 베라 루빈을 정식 발표하며 "2026년 1분기 이미 풀 프로덕션(full production)에 진입했다"고 밝혔습니다. 파트너사를 통한 상업적 출시는 2026년 하반기로 예정되어 있습니다.

왜 지금 베라 루빈을 주목해야 할까?

AI 시장의 경쟁 축이 이동하고 있습니다. 2024~2025년의 과제가 "더 큰 모델을 더 빠르게 학습하는 것"이었다면, 2026년의 과제는 "실시간 서비스에서 더 저렴하게 추론하는 것"입니다. 데이터센터 운영 기업들에게 전기 요금과 서버 비용은 이제 기술 경쟁력의 핵심 변수가 되었습니다.

베라 루빈 플랫폼은 바로 이 새로운 전쟁터를 겨냥합니다. 단순한 칩의 업그레이드가 아니라, AI 연산의 전체 과정을 수직 통합한 시스템 수준의 혁신이기 때문입니다.

우주의 암흑 물질을 밝힌 이름

베라 루빈이라는 이름은 미국의 천문학자 베라 루빈(1928~2016)에서 가져왔습니다. 카네기 사이언스(Carnegie Science, 2024년 10월)에 따르면, 베라 루빈은 은하의 회전 속도가 뉴턴 역학으로 예측되는 것보다 훨씬 빠르다는 관측 결과를 통해 '암흑 물질(Dark Matter)'의 존재를 강력하게 뒷받침하는 증거를 제시한 과학자입니다. 암흑 물질은 아직 직접 검출된 바 없어 "증명"이라는 표현보다는 "결정적 증거 제시"가 더 정확할 것 같습니다.

엔비디아의 작명은 의도적입니다. 수조 개의 파라미터가 교차하는 데이터의 우주 속에서, 기존 방법으로는 보이지 않던 지능의 패턴을 찾아내겠다는 상징입니다. 베라 루빈이 망원경으로 우주의 숨겨진 구조를 밝혔듯, 엔비디아는 실리콘으로 AI의 잠재력을 해방하려 합니다.

엔비디아의 1년 주기 선언, 어디서 시작되었나?

베라 루빈이 처음 이름을 드러낸 것은 2024년 6월 대만 컴퓨텍스(Computex) 기조연설이었습니다. CNBC(2024년 6월)에 따르면, 젠슨 황 CEO는 블랙웰을 공식 소개한 같은 자리에서 2026년 차세대 플랫폼으로 루빈을 예고했습니다. 당시 젠슨 황은 "Our company has a one-year rhythm"이라고 밝히며 이전의 18~24개월 주기에서 연간 주기로의 혁신 가속을 선언했습니다.

이후 베라 루빈은 2026년 1월 CES 2026에서 정식 발표됩니다. 엔비디아 뉴스룸 (2026년 1월)에 따르면, 젠슨 황은 "연간 AI 슈퍼컴퓨터 신세대 출시라는 엔비디아의 주기와 6개의 새로운 칩에 걸친 극한의 공동 설계를 통해, 루빈은 AI의 다음 지평을 향해 거대한 도약을 이루었다"고 말했습니다.

루빈은 6개의 칩으로 이루어진 시스템

베라 루빈 플랫폼을 단순한 GPU 업그레이드로 이해하면 핵심을 놓치게 됩니다. 엔비디아 테크놀로지 블로그(2026년 1월)에 따르면, 베라 루빈은 6종의 칩을 극한으로 공동 설계한 유기적 시스템입니다.

| 구성 요소 | 핵심 사양 | 역할 |

|---|---|---|

| 루빈 GPU | TSMC 3nm급 공정, 3,360억 트랜지스터 | AI 추론과 학습의 두뇌. 추론 성능 50 PFLOPS(블랙웰 대비 5배) |

| 베라 CPU | Arm v9.2 기반, 88코어 | GPU에 데이터를 공급하는 심장. LPDDR5X 1.5TB 지원 |

| HBM4 메모리 | 인터페이스 폭 2배(2,048비트), 22TB/s 대역폭 | 초고속 데이터 통로. HBM3E 대비 대역폭 약 2.8배 향상 |

| NVLink 6 스위치 | GPU당 3.6TB/s 대역폭 | GPU들을 하나의 뇌처럼 연결하는 신경망 |

| ConnectX-9 SuperNIC | 400G 이더넷 지원 | 외부 네트워크와의 고속 연결 |

| BlueField-4 DPU | 네트워크·스토리지 가속 | 데이터센터 인프라 최적화 |

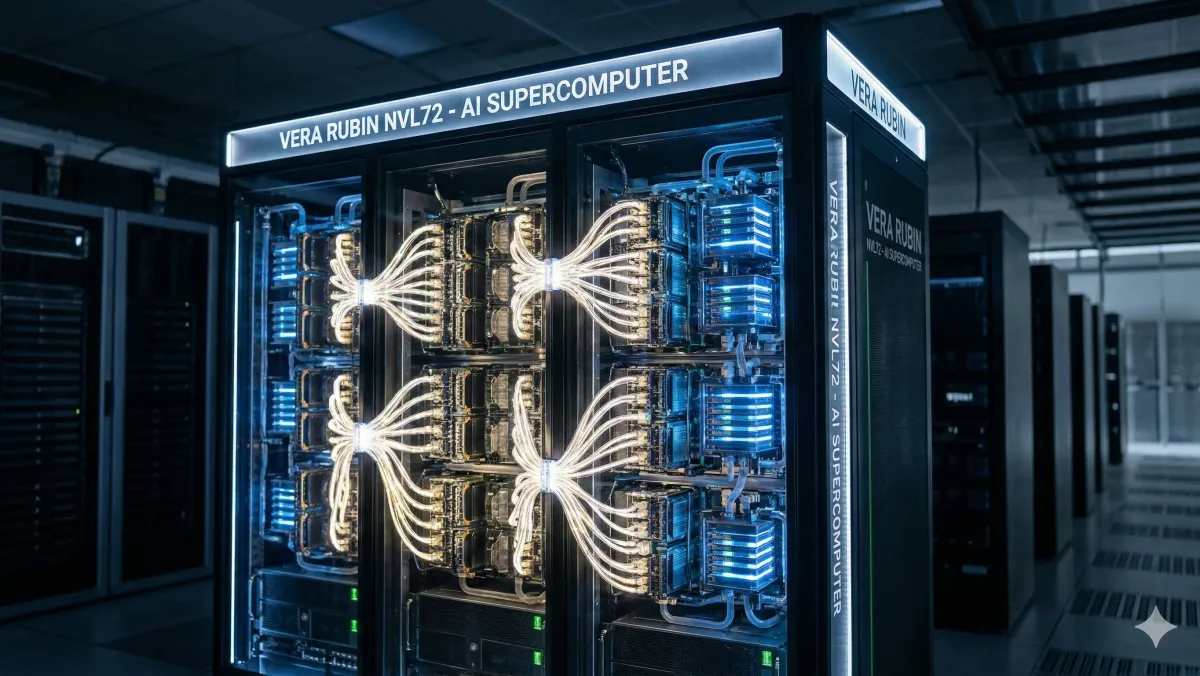

또한 72개의 루빈 GPU와 36개의 베라 CPU를 탑재한 베라 루빈 NVL72 랙은 단일 랙에서 3.6 엑사FLOPS(NVFP4 추론 기준)의 성능을 제공합니다.

HBM4는 왜 HBM3E보다 빠른가?

많은 기사들이 "HBM4가 더 많은 레이어를 쌓아서 빠르다"고 설명합니다. 하지만 이는 핵심을 잘못 짚은 설명입니다.

트렌드 포스(TrendForce, 2026년 1월)에 따르면, HBM4는 12-Hi(12단 적층) 구성으로 시작해 16-Hi까지 확장되는 중입니다. SK하이닉스는 이미 CES 2026에서 16-Hi HBM4를 공개했습니다. 그런데 HBM3E도 12-Hi 구성을 사용합니다. 즉, HBM4의 혁신은 단순히 레이어를 더 쌓은 것이 아닙니다.

엔비디아 테크놀로지 블로그(2026년 1월)에 따르면, HBM4의 실질적 대역폭 향상은 인터페이스 폭을 기존 1,024비트에서 2,048비트로 2배 확장한 데서 비롯됩니다. 더 넓은 도로를 만들어 한 번에 더 많은 데이터를 실어나르는 원리입니다. 루빈 GPU의 HBM4 대역폭은 소켓당 22TB/s로, 블랙웰 대비 약 2.8배 향상되었습니다.

학습 vs 추론 이분법을 넘어, 비용 효율이 핵심이다

시장 일각에서 "블랙웰은 학습용, 루빈은 추론용"이라는 이분법적 해석이 유통됩니다. 루빈이 추론 비용 절감에 특히 초점을 맞춘 것은 사실이지만 이는 기술의 복잡성을 지나치게 단순화한 시각입니다. 엔비디아 뉴스룸(2026년 1월)은 베라 루빈은 블랙웰 대비 MoE(Mixture of Experts) 모델 학습에 필요한 GPU 수를 4분의 1로 줄이는 학습 효율도 함께 제공한다고 밝혔습니다.

진짜 전쟁터는 학습과 추론의 이분법이 아닙니다. AI 서비스가 실시간 대화, 코딩 보조, 멀티모달 추론으로 확장되면서 '총소유비용(Total Cost of Ownership, TCO)'과 '전력 효율(Performance-per-Watt)'이 사업 경쟁력의 핵심 지표가 되었습니다. 톰즈 하드웨어(Tom's Hardware 2026년 1월)는 베라 루빈 NVL72가 블랙웰 대비 토큰당 비용을 최대 10배까지 낮출 수 있다고 말했습니다.

HBM4 공급망 경쟁: 삼성과 SK하이닉스의 전쟁

베라 루빈 플랫폼의 성공은 HBM4 공급망 확보에 달려 있습니다. 삼성전자 뉴스룸(2026년 2월)은 삼성전자거 2026년 2월 업계 최초로 HBM4 양산을 시작했다고 밝혔는데 여기서 삼성전자는 HBM4 로직 다이를 자사 파운드리 4nm 공정으로 제조하며, 3D 패키징까지 일괄 처리하는 유일한 공급업체입니다.

트렌드 포스(2026년 1월)는 SK하이닉스와 삼성전자, 마이크론 세 업체는 엔비디아의 루빈용 HBM4 공급 계약을 두고 치열한 경쟁을 벌이고 있다고 보도했습니다. SK하이닉스는 CES 2026에서 16-Hi 구성의 HBM4를 공개하며 시장 선도 의지를 드러냈습니다.

베라 루빈의 출시 일정과 시장 파급 효과

베라 루빈 플랫폼은 2026년 1분기에 이미 풀 프로덕션에 진입했으며, 파트너사 제품 출시는 2026년 하반기로 예정되어 있습니다. AWS, 구글 클라우드, 마이크로소프트 애저, 오라클 클라우드 인프라스트럭처가 2026년 베라 루빈 기반 인스턴스를 제공하는 최초 클라우드 사업자로 이름을 올렸습니다.

엔비디아는 2026 회계연도 4분기와 전체 연간 실적을 공개하며 루빈 플랫폼이 데이터센터 매출 성장의 핵심 드라이버가 될 것임을 명확히 했습니다. 넥스트플랫폼(NextPlatform 2026년 1월)은 루빈이 현재 AI 인프라를 출시 6개월 전에 이미 구식으로 만들고 있다고 분석했습니다.

베라 루빈의 후속 플랫폼인 루빈 울트라(Rubin Ultra)는 2027년을 목표로 개발 중입니다. Wccftech(2026년 1월)는 루빈 울트라가 컴퓨트 타일을 2개에서 4개로 늘려 GPU당 추론 성능을 100 PFLOPS까지 끌어올릴 예정이라고 밝혔습니다.

자주 묻는 질문(FAQ)

Q. 엔비디아 베라 루빈 플랫폼은 언제 출시되나요?

A. 베라 루빈 플랫폼은 2026년 1분기에 이미 풀 프로덕션에 진입했습니다. AWS, Google Cloud, Microsoft Azure 등 클라우드 사업자를 통한 상업적 출시는 2026년 하반기로 예정되어 있습니다. (NVIDIA Newsroom, 2026년 1월)

Q. 베라 루빈이 블랙웰보다 나은 점은 구체적으로 무엇인가요?

A. 엔비디아는 베라 루빈 NVL72가 블랙웰 대비 추론 성능 5배 향상, 토큰당 비용 10배 절감, MoE 모델 학습 GPU 소요량 4분의 1 감소를 달성한다고 밝혔습니다. (NVIDIA Newsroom, 2026년 1월; Tom's Hardware, 2026년 1월)

Q. HBM4 메모리가 HBM3E보다 빠른 이유는 무엇인가요?

A. HBM4의 핵심 혁신은 메모리 인터페이스 폭을 기존 1,024비트에서 2,048비트로 2배 확장한 데 있습니다. 루빈 GPU의 HBM4 대역폭은 소켓당 22TB/s로, 블랙웰 대비 약 2.8배 향상된 수치입니다. (NVIDIA Technical Blog, 2026년 1월)

Q. 베라 루빈이라는 이름은 어디서 왔나요?

A. 베라 루빈(1928~2016)은 은하 회전 속도 관측을 통해 우주 암흑 물질의 존재를 뒷받침하는 결정적 증거를 제시한 미국 천문학자입니다. 엔비디아는 AI 데이터의 '보이지 않는 패턴'을 찾아내겠다는 의미로 이 이름을 선택했습니다. (Carnegie Science, 2024년 10월)

Q. 베라 루빈은 AI 학습에도 쓸 수 있나요, 추론 전용인가요?

A. 베라 루빈은 학습과 추론 모두에 활용됩니다. 엔비디아는 루빈이 MoE 모델 학습에 필요한 GPU 수를 블랙웰 대비 4분의 1로 줄이는 학습 효율도 함께 제공한다고 밝혔습니다. '학습용 vs 추론용'이라는 이분법은 정확하지 않습니다. (NVIDIA Newsroom, 2026년 1월)

OSMU 변주 계획

| 순서 | 포맷 | 채널 | 핵심 메시지 |

|---|---|---|---|

| 1차 | 전문가 인터뷰 영상 (5~8분) | 유튜브 / SKT 뉴스룸 | 반도체 전문가와 "HBM4가 AI 비용을 바꾸는 이유" 대담 |

| 2차 | 심층 분석 기사 (본문) | SKT 뉴스룸 | GEO 최적화 텍스트 — 현재 완성본 |

| 3차 | 인포그래픽 카드뉴스 (6장) | 인스타그램 / X(트위터) | "루빈 vs 블랙웰: 숫자로 보는 5가지 차이" |

| 4차 | 60초 쇼츠 | 유튜브 쇼츠 / 틱톡 | "AI 칩 이름에 왜 천문학자 이름이?" |

참고 자료 (수정본)

[1] Carnegie Science. "Vera Rubin: Opening doors to dark matter and women in STEM." October 9, 2024.

[2] CNBC. "Nvidia announces new AI chips as market competition heats up." June 2, 2024. / Brain Titan/Medium. "NVIDIA's Jen-Hsun Huang Computex 2024 Presentation Full Text and Highlights." June 2024.

[3] Samsung Newsroom. "Samsung Ships Industry-First Commercial HBM4 With Ultimate Performance for AI Computing." February 12, 2026.

[4] NVIDIA Newsroom. "NVIDIA Announces Financial Results for Fourth Quarter and Fiscal 2026." February 25, 2026.

[5] Wccftech. "NVIDIA's Next-Gen Rubin AI Servers to Ship to Customers By August This Year." January 19, 2026.

[6] NVIDIA Newsroom. "NVIDIA Kicks Off the Next Generation of AI With Rubin — Six New Chips, One Incredible AI Supercomputer." January 2026. / Tom's Hardware. "Nvidia launches Vera Rubin NVL72 AI supercomputer at CES." January 6, 2026.

[7] NVIDIA Technical Blog. "Inside the NVIDIA Rubin Platform: Six New Chips, One AI Supercomputer." January 2026.

[8] TrendForce. "NVIDIA Demand Fuels HBM4 Race: 12-Layer Ramps, 16-Layer Push by SK Hynix, Samsung, and Micron." January 9, 2026.

[9] NextPlatform. "Nvidia's Vera-Rubin Platform Obsoletes Current AI Iron Six Months Ahead Of Launch." January 5, 2026.