앤트로픽과 국방부의 대결: 법원이 막아선 펜타곤의 AI 보복

2026년 3월, 미국 캘리포니아 연방법원이 앤트로픽에 내려진 공급망 위험 지정을 위헌으로 판단했다. 자율무기와 대규모 감시에 AI를 쓰지 않겠다는 원칙을 고수한 기업이 블랙리스트에 오른 사건이다. 국방부 자체 기록은 지정 이유가 국가안보가 아니라 언론을 통한 적대적 방식이었음을 인정했다. 법원은 그 기록으로 지정을 막았다. AI 안전 원칙과 군사 조달 권력의 첫 번째 법적 충돌, 그 판결의 무게를 짚는다.

레이 | 디지털 저널리스트 | awesome.ai.life@gmail.com | 2026년 3월 27일

미국 법원이 AI를 군사적 목적으로 쓰지 않겠다고 한 기업에 대해 국방부가 안보 위협으로 낙인찍은 행위를 위헌으로 판단했다. 이것은 AI 안전 원칙과 군사 조달 권력 사이의 첫 번째 법적 충돌이다.

앤트로픽의 클로드와 미 국방부의 법정 다툼에서 클로드가 1차 승리했다. 나는 이미 이 내용에 대해 두 개의 글을 썼고 내 결론은 미 국방부와 트럼프 행정부가 지나치게 오버하고 있다는 것이다.

계약, 그리고 거부: 무엇이 문제였나

다시 요약하면 이렇다. 2025년 7월, 앤트로픽과 미 국방부는 2억 달러 규모의 계약을 체결했다. 클로드는 이 계약으로 미국 정부 기관의 기밀 네트워크에 배치된 최초의 첨단 AI 모델이 되었다. 계약 조건에는 앤트로픽의 허용 사용 정책(Acceptable Use Policy, AUP)을 국방부가 준수한다는 내용이 포함되어 있었다.

갈등은 재계약 협상에서 불거졌다. 국방부는 두 가지 핵심 제한 조항, 이를테면 완전 자율 무기 시스템(fully autonomous weapons systems)과 국내 대규모 감시(mass domestic surveillance)에 대한 사용 금지를 삭제하라고 요구했고 앤트로픽은 이를 거부했다. 앤트로픽 CEO 다리오 아모데이(Dario Amodei)는 두 제한이 "양심상 양보할 수 없는" 영역이라는 입장을 유지했다. 그 양심이 어떤 철학적 토대 위에 서 있는지는 앤트로픽 안전팀 리더의 사임이 드러낸 내부 동학을 추적한 이전 글에서 다룬 바 있다.

이 거부의 무게를 이해하려면 숫자 하나를 먼저 봐야 한다. 미국 정부는 앤트로픽의 단일 최대 고객이다. 그 고객이 "모든 합법적 목적을 위한 무제한 접근"을 요구하는 것은 어쩌면 당연한 일이다. 하지만 고객은 모든 합법적 목적이라는 것을 자기 입맛에 맞게 해석했고 기업이 이를 거절했을 때 결국 다툼이 생겼다.

2026년 2월 24일, 국방장관 피트 헤그세스(Pete Hegseth)는 아모데이에게 최후통첩을 전달했다. 기한은 2월 27일 오후 5시 1분. 앤트로픽은 2월 26일 굴복하지 않겠다는 성명을 발표했고 다음 날 트럼프 대통령은 모든 연방 기관에 앤트로픽의 기술을 사용하지 말라고 지시했다. 헤그세스는 같은 날 앤트로픽을 공급망 위험(supply chain risk)으로 지정했다.

이렇게 지정했다는 맥락이 중요하다. 공급망 위험 지정은 연방법상 "적대 세력이 국가안보 시스템을 방해하거나 전복할 위험"을 뜻하며, 역사적으로 외국 기업 특히 중국 통신 장비 기업들에게 적용되어 왔다. 2026년 3월 3일, 국방부가 앤트로픽을 여기에 걸었다는 건 미국 기업에 내려진 최초의 공급망 위험 지정이었다.

법정에서 드러난 것: 국가안보가 아니었다

법정은 때로 문서보다 솔직하다(이 경우는 그렇다). 3월 24일 샌프란시스코 연방법원의 90분 심리에서 리타 린(Rita Lin) 판사는 정부 측 변호인을 거듭 압박했다. "만약 우려가 작전 지휘 계통의 무결성에 관한 것이라면, 국방부는 그냥 클로드를 사용하지 않으면 되는 것 아니냐." 이것은 법적 수사가 아니라 논리의 정곡이다. 국가안보가 진짜 이유였다면 관계를 끊으면 그만이다. 굳이 블랙리스트에 올릴 이유가 없다.

정부 측 변호사 에릭 해밀턴(Eric Hamilton)은 "앤트로픽이 킬 스위치를 설치하거나 모델 작동 방식을 바꿀 수 있다는 우려"를 내세웠다. 이 논거는 좀 웃긴다. 논거라고 할 수도 없을 것 같지만. 그 우려가 실재한다면 AI 계약을 맺는 모든 정부는 모든 AI 기업을 잠재적 위험으로 지정할 수 있다는 논리가 된다.

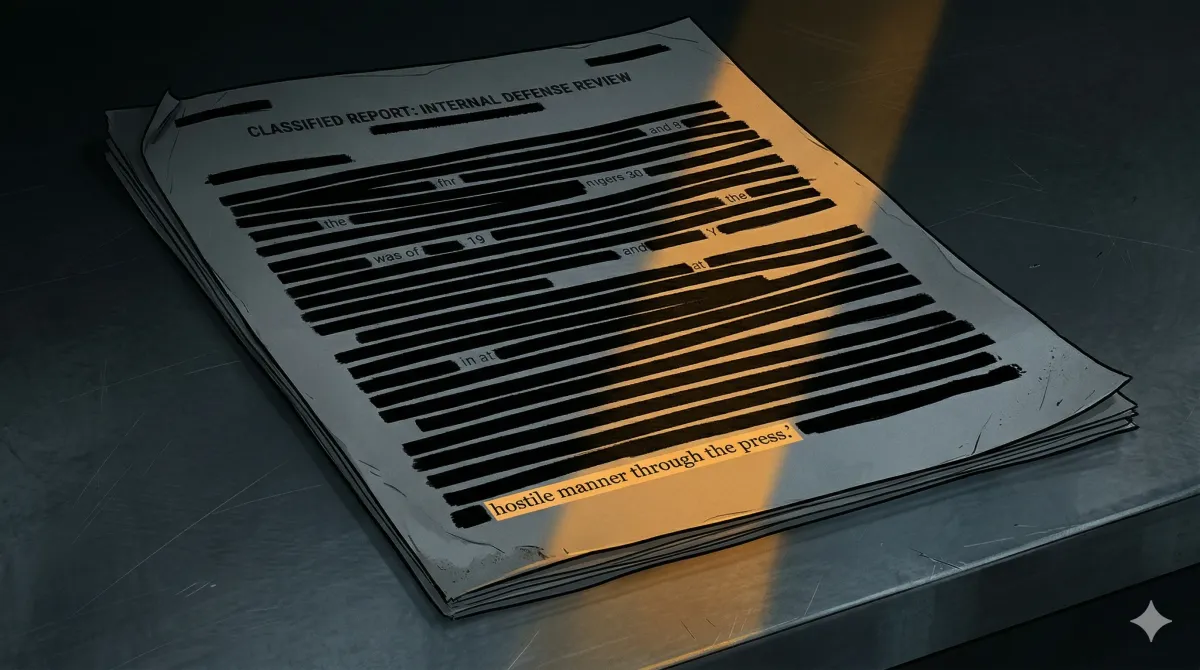

그러나 법원을 설득하지 못한 것은 논거의 빈약함이 아니었다. 국방부의 자체 기록이었다. 린 판사의 판결문에는 국방부 내부 기록에 앤트로픽이 "언론을 통한 적대적 방식(hostile manner through the press)" 때문에 공급망 위험으로 지정되었다고 명시되어 있다는 사실이 인용되었다. 행정부가 법정에서 "국가안보"를 주장하는 동안, 행정부의 문서는 "이 회사가 우리 말을 듣지 않는다."는 주장을 하고 있었다.

판결이 말한 것, 말하지 않은 것

린 판사는 3월 26일 앤트로픽의 예비 금지명령(preliminary injunction) 신청을 인용했다. 이 결정은 공급망 위험 지정의 시행을 차단하고 모든 연방 기관에 앤트로픽 기술 사용을 즉시 중단하라는 트럼프 대통령의 명령도 함께 막았다.

판사가 제시한 세 가지 위헌 근거는 각각의 무게가 다르다. 수정헌법 제1조(표현의 자유) 위반은 가장 직접적이다. 공급망 위험 지정의 실제 이유가 국가안보가 아니라 앤트로픽의 공개 발언이었다는 것이 행정부 자체 문서로 확인된 이상, 이것은 표현을 이유로 한 처벌, 미국 헌법이 가장 명시적으로 금지하는 행위에 해당한다.

적법절차(due process) 위반은 절차의 문제다. 앤트로픽은 공급망 위험으로 지정되기 전에 반박할 기회를 전혀 부여받지 못했다. 지정이 먼저 내려지고 소송이 뒤따른 것이다. 마지막으로 법령 범위 초과는 법 해석의 문제다. 공급망 위험 지정에 관한 법령(10 U.S.C. § 3252)은 외국 적대 세력을 상정해 만들어진 것이며 린 판사는 앤트로픽이 그 법령의 적용 대상에 해당하지 않음을 정부가 입증하지 못했다고 판단했다. 세 근거 중 어느 하나만 인정되어도 지정은 무효화된다. 법원은 세 개를 모두 인정했다.

그러나 린 판사는 이 판결이 어디까지인지를 명확히 선을 그었다. 판사는 판결문에서 "어떤 AI 제품을 사용할지는 국방부의 고유 권한"이라고 밝혔다. 군사 AI 정책의 옳고 그름을 법원이 판단한 것이 아니다. 법원이 판단한 것은 하나다. 정부가 자신의 결정에 동의하지 않는 기업을 처벌하기 위해 법령을 사용하는 것이 합법인가.

판사의 답은 명확했다.

물론 이것이 확정 판결이 아니라는 사실은 주목할 필요가 있다. 사실 린 판사는 판결 효력을 7일간 정지하여 정부가 항소할 기회를 부여했다. D.C. 연방 항소법원에 계류 중인 병행 소송도 아직 끝나지 않았다. 예비 금지명령은 "앤트로픽의 승소 가능성이 높다"는 판단이지, 최종 결론이 아니다.

시장은 이미 답했다: 그러나 그 답은 하나가 아니다

법원이 심리하는 동안 시장은 두 개의 상반된 신호를 동시에 발신했다. 블랙리스트 지정 당일, 오픈AI는 국방부와 분류 군사 환경에서 챗지피티를 배치하는 계약을 체결했다고 발표했다. 앤트로픽의 자리를 실질적으로 채운 것이다. 군사 AI 시장에서 사용 제한을 거부한 기업의 자리는 즉시 채워진다.

동시에, 펜타곤 분쟁이 공론화된 후 한 주 동안 앤트로픽의 신규 가입자는 하루 100만 명을 넘어섰고, 클로드는 애플 앱스토어 기준 16개국에서 1위를 기록했으며 앱피규어(AppFigures) 집계로는 20개국 이상의 전체 앱 마켓에서 챗지피티와 제미나이를 추월했다.

이 두 숫자를 어떻게 읽어야 하는가. 군사 계약 시장과 소비자 시장은 같은 방향을 바라보지 않는다. 자율무기 사용을 거부한 AI 기업이 소비자의 신뢰를 얻는 것과 그 거부로 인해 군사 조달에서 퇴출되는 것은 동시에 일어날 수 있다. 이 갈라짐 현상이 앞으로 AI 기업들이 직면할 구조적 선택지다.

이것이 만든 지형: 선례의 무게

이번 사건은 두 가지 전례를 남긴다. 하나는 법적 전례다. 미국 법원이 AI 기업의 사용 제한 정책을 이유로 한 정부의 보복 조치를 위헌으로 판단했다. 이 판결은 AI 기업이 자사 모델의 사용 방식에 스스로 제한을 걸 수 있는 권리를 법적으로 방어할 수 있음을 처음으로 확인했다. 정치적 전례는 다른 차원이다. 정부 조달 시장에서의 퇴출이 AI 안전 원칙을 고수한 기업에 대해 정부가 조달 시장 퇴출이라는 무기를 시도했고 이 시도가 실패로 끝났다는 기록이 남았다.

린 판사는 군사 AI 정책의 옳고 그름을 선언하지 않았다. 드라마도 붙이지 않았다. 그저 법령의 범위를 끝까지 엄밀하게 읽었고, 그 읽기의 결과로 지정을 막았다. 그 엄밀성이 남긴 두 개의 사실은 지워지지 않는다. 첫째, 행정부의 문서는 공급망 위험 지정의 실제 이유가 국가안보가 아니었음을 스스로 기록했다. 둘째, 법원은 그 기록을 근거로 지정을 막았다. 이 두 사실은 이후 유사한 사안에서 참조될 것이다.

이것이 이번 판결의 진짜 무게다. 린 판사는 군사 AI 정책의 방향을 바꾼 것이 아니다. AI 기업과 정부 사이의 충돌에서 어떤 근거로 법원이 개입할 수 있는지를 처음으로 보여준 것이다. 이 충돌의 구조적 기원 — 자율무기가 민주주의의 책임 연쇄를 어떻게 해체하는가 — 을 먼저 읽고 싶다면 이 글을 보라.

그 충돌은 이번이 마지막이 아닐 것이다. / raylogue