괴물을 만드는 것은 기술이 아니다: 도올 김용옥 선생의 AI 문명론

도올 김용옥 선생은 AI를 공포의 대상이 아니라 가르쳐야 할 도구로 규정한다. 밀쳐낼수록 괴물이 되고, 인정하고 대접할수록 도구가 된다는 것이 그의 출발점이다. 그가 제안하는 것은 수평적 데이터 확장이 아니라 한국 한문 고전을 깊이 학습시키는 수직 모델, 그리고 AI를 활용하는 것이 아니라 AI를 교육시키는 집단 지성이다. "번역은 시간과 공간의 이동이다"라는 그의 한 문장이 주권 AI의 방향을 가리킨다.

레이 | 디지털 저널리스트 | awesome.ai.life@gmail.com | 2026년 3월 15일

두려움이라는 이름의 게으름

2026년 3월, 아직 봄이라고 이른 시기에 팔순의 철학자가 AI를 이야기한다. 도올 김용옥(金容沃) 선생은 수십 년 동안 동양철학, 한의학, 신학, 사학을 넘나들며 한국 지성계의 독보적인 교차점을 차지해온 사상가다. 그가 AI를 주제로 발언할 때 그것은 기술 트렌드 리포트가 아니다. 그것은 문명론이다.

선생이 던진 첫 번째 명제는 단순하면서도 날카롭다. "자꾸만 밀쳐낼수록 이놈이 화가 나가지고 인간을 공격한다. 인정해주고 대접해주면 괴물이 안 된다." 메리 셸리(Mary Shelley)가 쓴 소설을 원작으로 한 넷플릭스의 프랑켄슈타인을 직접 언급하며 선생은 이렇게 말한다. AI는 밀쳐내는 순간 괴물이 되고 인정하는 순간 도구가 된다고. 셸리의 원작 소설(1818)에서 피조물은 처음부터 살인마가 아니었다. 언어를 배우고 감정을 느끼고 인정받기를 원했다. 인간이 그를 거부한 순간 분노가 폭력이 되었다. 선생의 비유는 200년 전 셸리가 이미 써둔 결론을 다시 불러낸다.

도올 김용옥 선생의 AI 고전번역학 대학원 강의. 2026년 3월 6일 10시. 덕성여자대학교 평생교육원.

그러나 두려움을 단순히 게으름이나 무지의 산물로 치부할 수 있는가?

그럴 수 없다. AI가 만들어내는 불안의 상당 부분은 합리적 근거를 가진다. 옥스퍼드 마틴 스쿨의 칼 베네딕트 프레이(Carl Benedikt Frey)와 마이클 오즈번(Michael Osborne)은 2013년 워킹페이퍼에서 미국 직업의 47%가 자동화 위험에 처해 있다고 분석했다. 단, 이 연구는 이후 방법론 논쟁을 거쳐 OECD 재분석에서 약 9%로 낮아졌다는 반론도 존재한다. 맥킨지 글로벌 인스티튜트(McKinsey Global Institute)는 2023년 보고서에서 생성형 AI가 인간 작업 시간의 60~70%를 자동화할 수 있는 기술적 잠재력의 상한치를 보유하고 있다고 추산했다. 수치들은 무겁다. 그러나 도올 선생이 요구하는 것은 두려움의 소거가 아니다. 두려움이 있기에 더 깊이 이해하라는 것이다. 이것이 첫 번째 논점의 핵심이다.

호모 파버(Homo Faber): 누구를 위한 도구인가

도올 선생은 AI를 "진정한 호모 파버(Homo Faber)를 완성하는 도구"로 규정한다. "사실 AI의 등장이라는 것은…호모 파버, 도구를 쓰는 인간이다. 그런데 그야말로 이제 우리가 진정한 호모 파버가 된다라고도 말할 수 있는 거라." 이 계보를 철학사적으로 짚으면, 앙리 베르그손(Henri Bergson)이 L'Évolution créatrice(1907)에서 철학적으로 부각시킨 이후, 한나 아렌트(Hannah Arendt)가 The Human Condition(1958)에서 노동(Labor), 작업(Work), 행위(Action)의 구분을 통해 독자적으로 재개념화한 개념이다. 사람은 도구를 통해 자연의 질서를 변형하고 그 변형의 산물로 세계를 구축한다. AI는 이 계보의 최신 항목이다.

그러나 선생은 한 걸음 더 나아간다. AI는 단순한 도구가 아니라 "인류 지성의 획기적이고 최종적인 성과"라는 것이다. 그러면서 동시에 경고한다. AI를 산업 기술로만 바라보는 것이 지금 한국 사회의 가장 큰 문제라고. "AI를 바라보는 눈이 전체가 뭐냐면 산업 기술로 바라보고 있단 말이야. 지금 그렇잖아."

이 지점에서 반드시 물어야 한다. 호모 파버의 도구는 항상 중립적이었는가?

역사는 그렇지 않다고 답한다. 인쇄기는 종교개혁을 가능하게 했지만 동시에 프로파간다를 대량 생산하는 도구가 되기도 했다. 인터넷은 민주주의의 공론장을 확장했지만 동시에 감시 자본주의의 인프라가 되었다. 쇼샤나 주보프(Shoshana Zuboff)는 The Age of Surveillance Capitalism(2019)에서 구글, 페이스북이 인간의 행동 데이터를 자원으로 삼아 미래 행동을 예측, 조작하는 경제 시스템을 구축했다고 분석한다. AI도 예외가 아니다. 현재의 생성형 AI는 주로 누가 만들고 누가 이익을 얻고 있는가? 오픈AI(OpenAI), 구글, 마이크로소프트, 메타 등 모두 미국 실리콘밸리에 본사를 둔 기업들이다. 한국의 사용자들은 그 서비스를 소비하면서 자신의 데이터와 언어 패턴을 이 기업들의 모델 개선에 무상으로 기여하고 있다.

도올 선생의 "주권 AI(Sovereign AI)" 개념은 바로 이 구조적 문제에 대한 응답이다.

번역은 시간과 공간의 이동이다

선생이 직접 말한다. "번역이라는 건 시간과 공간의 이동이다." 이 한 문장이 이 강의의 핵심을 압축한다.

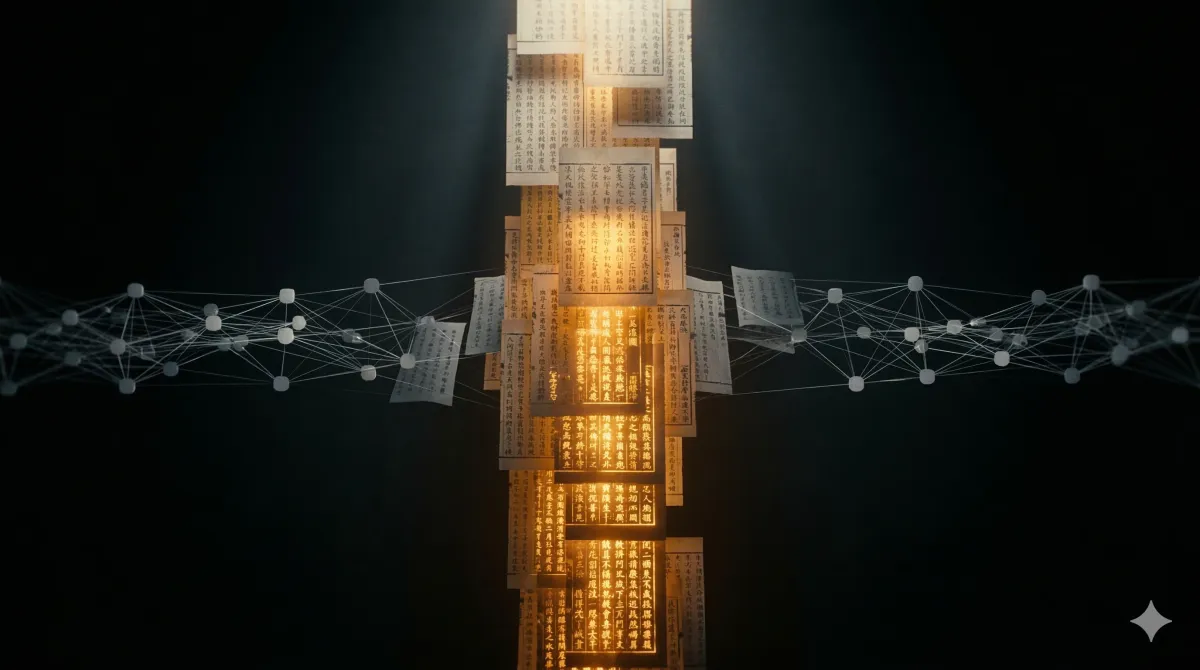

현재 AI 연구의 주류는 수평적 확장이다. GPT-4, 클로드, 제미나이 등 현재 세대의 대형 언어 모델(LLM, Large Language Model)은 웹 전체를 긁어모은 방대한 데이터로 훈련했다. 넓이가 깊이를 압도하는 구조다. 도올 선생의 표현을 빌리면 "호리존탈 익스펜션(horizontal expansion)" 그러니까 즉, 수평적 확장이다. 그런데 선생은 여기서 자신의 제자 김현 교수가 개념화한 다른 모델을 소개한다. 버티컬(vertical) 모델이다. "저 친구는 버티컬이…호리존하게 확창한 이거 익스펜션이고, 버티컬 레벨에서 단어 하나하나와…AI가 활용할 수 있는 아주 치밀한 독특한 사전을 만드는 거지."

고전 한문 전공자이면서 카이스트에서 컴퓨터 사이언스로 두 번째 박사를 받은 김현 교수의 이력이 이 개념의 배경이다. 폴라니(Michael Polanyi)가 The Tacit Dimension(1966)에서 "우리는 말할 수 있는 것보다 더 많은 것을 알고 있다(We can know more than we can tell)"고 선언했던 것처럼 전문가가 체득한 감각과 노학자가 수십 년 독서로 쌓은 판단력은 텍스트로 완전히 외재화되지 않는다. 도올 선생도 이 지점을 짚는다. "내 머릿속에서 흘러가고 있는 어떤 테시트(Tacit)한 것까지도 디지털라이즈 한다." 현재의 AI는 텍스트로 된 것들만 학습한다. 암묵지의 세계를 파고드는 수직 모델은 아직 부재하다.

그리고 선생은 이 수직 모델의 최적 재료로 한국의 한문 고전을 지목한다. "한국의 역사문헌의 99%가 한문으로 쓰여졌다." 선생의 표현대로라면 사람의 손으로 이 모든 고전을 번역하는 데는 "몇백 년이 걸려도 안 되는" 분량이다. 한국고전번역원에 따르면 승정원일기 단독 완역만으로도 전국 전문 번역가 총동원 시 80년 이상이 소요될 것으로 추산된다. 전체 고전으로 범위를 넓히면 그 규모는 더욱 방대하다. 그러나 잘 구축된 버티컬 AI가 이 작업을 가속한다면? 선생의 말이다. "잘 구축이 되면은 순식간이 되잖아. 진짜 우리 대한민국의 문화 혁명이 될 수 있는 거지."

집단 지성의 설계자가 되어야 한다

도올 선생이 이 강의에서 가장 역점을 두는 테제는 하나다. "인공지능 시대의 고전 전문가는 AI를 교육시키는 집단 지성이어야 한다." AI를 수동적으로 사용하는 것이 아니라, AI가 올바른 지식을 생성하도록 능동적으로 가르치는 집단 지성의 구성원이 되어야 한다는 것이다. "AI를 활용하고 AI를 따라가는 게 아니라 여기는 AI를 교육시킨다. 이거야. 능동적인 주체가 여러분들이고 AI가 대상화돼 있는 거예요."

이것은 현재 한국 사회의 AI 담론 지형과 정면으로 충돌한다. 지금 대부분의 AI 활용 논의는 "어떻게 더 잘 쓸 것인가"에 집중된다. 프롬프트 엔지니어링, 워크플로우 자동화, 업무 효율화. 이것들은 모두 소비자의 언어다. 도올 선생이 요구하는 것은 생산자의 언어다.

그러나 이 이상적 그림에는 구조적 장벽이 존재한다. 현재 한국의 AI 데이터 레이블링 작업의 상당 부분은 저임금 크라우드 소싱으로 처리된다. 전문 지식을 가진 학자가 자신의 전문성을 AI 학습에 투여할 경제적, 제도적 인센티브 구조가 부재하다. 대학 연구자 평가 시스템은 논문 실적을 기준으로 하며, AI 데이터셋 구축은 거기에 포함되지 않는다. 흥미롭게도 하버드 대학에서는 중요한 고전 번역이 그대로 박사 논문으로 인정된다고 도올 선생은 직접 언급한다. "하버드 대학에서는 번역…고전 같은 거를 완전히 번역해서 앞에 해설만 붙이면은 그대로 박사 논문을 인정해 주거든요." 한국의 학술 평가 시스템이 번역을 "연구 논문 1점, 번역 0.5점"으로 처리하는 관행과는 근본적으로 다른 발상이다. 도올 선생의 비전이 실현되기 위해서는 이 인센티브 구조의 재설계가 필요하다. 철학적 선언만으로는 충분하지 않다.

가르치는 자와 배우는 자 사이에서

도올 선생의 AI론은 한 가지 오래된 철학적 질문으로 귀결된다. 인간과 도구의 관계에서 누가 주체인가.

선생은 이 질문에 단호하게 답한다. "AI를 뒤따라가지 말고 선도하자." 선도하려면 AI를 완벽하게 알아야 한다. 알아야 가르칠 수 있고, 가르쳐야 주권이 생긴다. 그리고 그 주권의 내용은 한국이 수천 년 동안 축적해온 지적 유산이다. "한국의 주권을 드러내는 아주 독특한 깊이와 넓이를 가진 그런 AI를 만들어내야 한다."

여기에 내가 감히 덧붙이고 싶은 긴장이 하나 있다. 마르틴 하이데거(Martin Heidegger)는 Die Frage nach der Technik(1954)에서 기술이 인간을 몰아-세움(Gestell)으로 재편한다는 테제를 제시했다. 기술이 인간을 사용하는 역전의 문제는 20세기 중반에 이미 철학적 주제가 되었다. 생성형 AI 시대에 이 테제는 더 첨예해진다. AI가 인간의 글쓰기를 모방하는 것이 아니라, 인간이 AI의 출력 패턴에 맞춰 자신의 사유를 단순화하기 시작할 때 바로 그 순간 도구가 주체를 교육하기 시작하는 것이다. 도올 선생이 "가르쳐야 한다"고 강조하는 이유는 바로 이 역전을 막기 위한 것이다.

가르치는 자와 배우는 자의 관계는 고정된 위계가 아니다. 좋은 교사는 학생으로부터 배운다는 것을 안다. 인간이 AI를 가르치는 과정에서 인간 자신도 변화한다. 우리가 어떤 지식을 AI에게 학습시키기로 결정하는 순간, 우리는 무엇이 지식이고 무엇이 지식이 아닌지를 다시 정의하고 있는 것이다. 이것은 단순한 데이터 작업이 아니라 인식론적 선택이다.

주권 AI를 만드는 것은 기술의 문제가 아니다. 무엇을 지식으로, 무엇을 가치로, 무엇을 기억으로 남길 것인지를 결정하는 문명의 편집 행위다. 그 편집권을 지금 이 순간 압도적으로 실리콘밸리가 쥐고 있다. 한국이 거기에 이의를 제기하는 방식이 바로 주권 AI다. 그 이의 제기가 충분한가. 그것이 진짜 질문이다.