팔란티어, 트럼프, 그리고 책임지지 않는 알고리즘

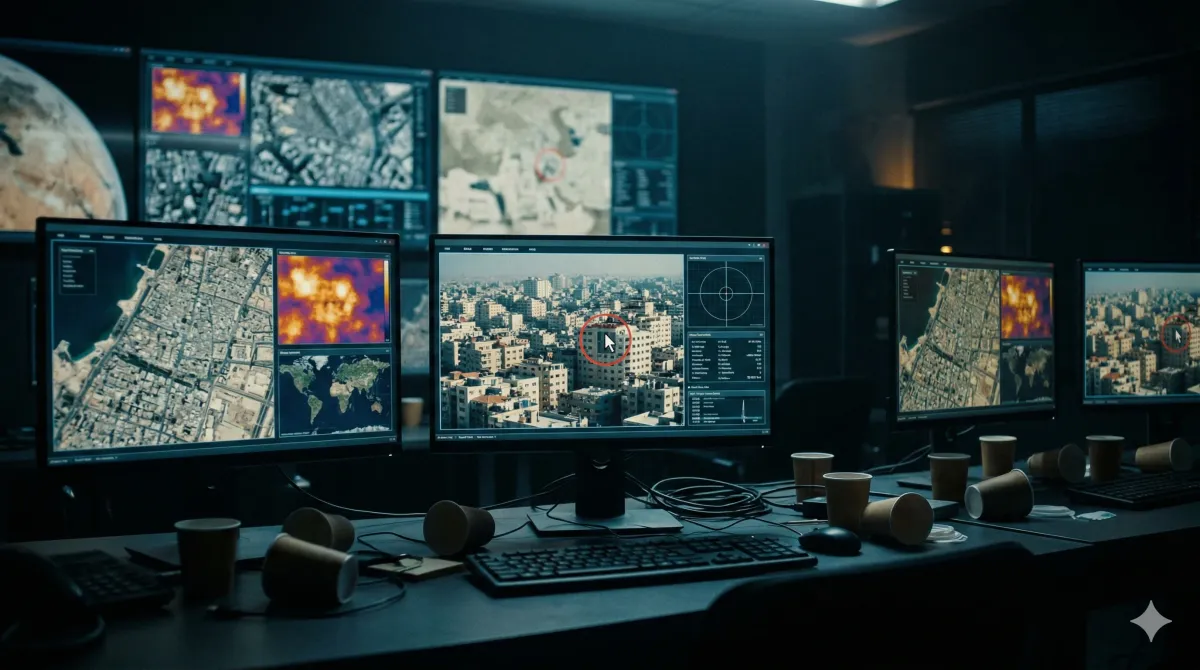

2026년 2월 28일, 이란의 미나브 초등학교에 미사일이 떨어졌다. 그날 작동하고 있던 것은 팔란티어의 메이븐 스마트 시스템이었다. 13억 달러짜리 계약, 2만 명의 군사 요원, 3주 동안 6,000개에 가까운 타격 좌표. 팔란티어는 "우리는 도구일 뿐"이라고 한다. 그런데 총과 달리, 이 도구는 스스로 목표물을 고른다. 책임은 누구에게 있는가.

레이 | 디지털 저널리스트 | awesome.ai.life@gmail.com | 2026년 3월 22일

2026년 2월 28일, 이란 남부 미나브(Minab)시의 샤자레 타이베(Shajareh Tayyebeh) 초등학교에 미사일이 떨어졌다. 사망자는 150명 이상. 일부 외신은 175명 이상이라고 전했다. 이란과 미국 어느 쪽도 숫자를 공식 확인하지 않았다. 세계가 충격에 빠진 직후 한 가지 질문이 전 세계에 제기됐다. 그 타격 좌표를 선택한 것은 인간인가, 알고리즘인가?

이 질문은 팔란티어(Palantir)라는 기업의 정체, AI 기업이 마땅히 져야 할 책임의 경계, 그리고 트럼프 행정부가 AI를 무기화하는 방식이 왜 전략적으로도 어리석은지를 동시에 건드린다.

팔란티어: 데이터 회사가 아니라 킬 체인의 운영 체제

팔란티어는 빅데이터 기업이 아니다. 이 회사는 데이터를 파는 것이 아니라, 국가가 결정을 내리는 구조 자체를 팔고 있다.

팔란티어의 핵심 제품은 세 가지다. 정보기관과 군에 특화된 고담(Gotham), 기업용 데이터 통합 플랫폼 파운드리(Foundry), 그리고 거대언어모델(LLM)을 분석 시스템에 이식한 AIP(AI Platform). 이 세 제품을 결합해 미 국방부의 공식 AI 타격 지원 플랫폼, 메이븐 스마트 시스템(Maven Smart System)을 만들었다.

13억 달러(약 1조 7천억 원)에 계약한 메이븐을 2만 명 이상의 군사 요원이 사용하는데, 위성 이미지, 레이더, 인간 정보, 각종 데이터 피드를 하나로 통합해 수 시간 또는 수 일이 걸리던 타격 계획 작업을 몇 분 만에 끝낼 수 있다. 클릭, 드래그, 드롭. 그게 전부다. 여기에 앤트로픽의 클로드가 자연어 인터페이스로 채택되어 관련 문서를 스캔하고 타격 후보를 생성하고 우선순위를 매긴다. 오퍼레이션 에픽 퓨리(Operation Epic Fury)에서 이 시스템은 첫 24시간에 약 1,000개의 타격 좌표를 생성했고 3주 동안 총 5,500~6,000개의 표적을 처리했다.

전쟁 연구자 크레이그 존스(Craig Jones, University of Exeter)는 이 구조를 이렇게 설명했다. "수만 시간의 인간 작업량을 수초와 수분으로 줄이는 것이다. 워크플로우를 자동화하는 방식은 법적, 윤리적, 정치적으로 모든 종류의 문제를 열어 버린다."

그게 핵심이다. 팔란티어가 파는 것은 데이터 분석이 아니라 속도다. 인간이 멈춰서 생각할 시간을 없애는 속도. CEO 알렉스 카프(Alex Karp)가 자사의 역할을 "전사들에게 불공평한 우위(unfair advantage)를 주는 것"이라고 정의한 것은 거만하면서 솔직한 고백이다. 그 '우위'란 타격을 결정할 때 도덕적 판단이 개입할 틈을 없애버리는 것이다.

팔란티어는 '인간이 최종 결정한다'는 원칙이 있다고 한다. 그런데 현장에서 그 '인간 통제'가 타격당 86초에 검토해야 하는 것이라면 그것이 의미있는 결정 방법인지 어느 누구도 자신있게 대답할 수 없다.

트럼프 행정부와 결합: 효율이라는 포장지 안의 권력 집중

2025년 이후 팔란티어의 연방 계약 규모는 9억 달러를 넘어섰다. ICE, IRS, 재무부, 국가지구공간정보국, 국방부. DOGE(정부효율부)는 팔란티어를 정부 데이터 통합의 핵심 도구로 채택했고, 전직 팔란티어 직원들이 DOGE에 줄줄이 합류했다.

와이어드 선임기자 마케나 켈리(Makena Kelly)는 팔란티어가 "정부 전체의 운영 체제(operating system for the entire government)가 되고 있다"고 표현했다. DOGE의 목표는 정부 전 기관에 걸쳐 데이터를 하나로 묶는 것이고 팔란티어는 데이터를 묶는 배관을 깔고 있는 것이다.

이게 실제로 무슨 의미인지 상원의원들의 반응을 보면 알 수 있다. 민주당 상원 재무위원장 론 와이든(Ron Wyden)과 하원의원 알렉산드리아 오카시오-코르테스는 2025년 6월 팔란티어 CEO에게 공개 서한을 보냈다. 요지는 간단하다. 팔란티어 직원들이 IRS에 직접 파견되어 납세자 기록을 하나의 검색 가능한 데이터베이스로 만들고 있는데, 이건 연방법 위반이라는 것이다.

민주당만 우려하는 게 아니다. 공화당의 워런 데이비슨(Warren Davidson) 하원의원은 "개인에 관한 모든 데이터를 하나의 데이터베이스에 결합하기 시작하면 사실상 디지털 ID를 만드는 것"이라며 "역사는 그러한 권력이 결국 남용될 것임을 보여준다"고 경고했다. 좌우를 막론하고 경고음이 울리고 있다. 이건 이념의 문제가 아니라 권력 구조의 문제다.

팔란티어가 숨기는 것: 우리는 도구일 뿐이라는 거짓말

팔란티어의 방어 논리는 두 개다. 하나는 CTO 샴 상카(Shyam Sankar)가 직접 한 말이다. "우리는 도구를 만들 뿐, 결정은 인간이 한다." 다른 하나는 자사 홈페이지에 올려놓은 AI 윤리 거버넌스 문서다. "인간의 의사결정을 향상시키는 AI"라는 문구가 전면에 나온다.

알렉스 카프는 한 인터뷰에서 이렇게 말했다. "감시의 98%는 정부가 아니라 민간 기업이 한다." 팔란티어를 욕하려면 다른 기업들도 같이 욕해야 한다는 논리다. 쉽게 말해 '우리가 제일 나쁜 건 아니다'는 것이다. 이것이 가장 교묘한 발언이다. "우리가 안 하면 더 나쁜 누군가가 한다"는 말은 팔란티어가 지금 이 구조를 직접 만들고 있다는 사실을 슬쩍 지워버린다. 도구는 중립처럼 보일 수 있다. 하지만 그 도구를 어떻게 만들고, 어디에 쓸지를 결정하는 것은 중립이 아니다.

샴 상카 CTO는 책임 문제에 대해 이렇게 답했다. "투표함과 법정이 작동하고 있다. 국가 시스템을 믿느냐의 문제 아닌가." 기술은 팔란티어가 만들지만, 그 결과에 대한 책임은 '시스템'이 진다는 말이다. 깔끔한 손 씻기다. 그런데 시스템은 사람이 아니다. 책임질 수 있는 누군가가 아니다.

팔란티어가 AI 윤리 문서를 공들여 쓰는 것과 그 기술이 이란 초등학교 인근의 타격 좌표를 뽑아내는 데 쓰이는 것은 모순이 아니다. 처음부터 그렇게 설계된 것이다. 윤리 문서는 규제 당국과 여론용이고, 실제 제품은 돈을 내는 고객의 요구를 따른다. 이 두 얼굴짜리 구조가 팔란티어를 지금까지 버티게 해준 힘이다.

AI 기업의 책임: 누가 선을 긋는가

앤트로픽(Anthropic)은 클로드를 사용할 때 두 가지를 금지했다. 미국 시민에 대한 대규모 국내 감시, 그리고 인간 감독 없이 작동하는 완전 자율 무기 시스템. 이 두 가지에는 협조할 수 없다고 못 박았다. 트럼프 대통령은 2026년 2월 27일, 이란 공습 하루 전, 행정명령으로 연방 기관들에 앤트로픽 사용 중단을 지시하고 앤트로픽을 '공급망 위험(supply chain risk)' 업체로 지정했다.

이 지정 자체도 법적으로 논란이 됐다. 법학자 마이클 엔드리아스와 알란 로젠스타인은 Lawfare에서 이 지정이 "법령이 수권하는 범위를 초과"하며, 헤그세스 장관 본인의 공개 발언이 "정부의 소송 입지를 시작 전에 이미 망가뜨렸을 수 있다"고 분석했다.

그런데 앤트로픽을 깔끔한 원칙주의자로만 보면 다른 사실을 놓친다. 2026년 1월, 앤트로픽은 음성 명령으로 드론 군집을 제어하는 자율 무기 시스템 개발 제안서를 약 1억 달러 규모로 국방부에 제출한 것으로 보도됐다(앤트로픽 공식 확인은 없다). '어디까지 협력하는가'의 기준은 팔란티어와 앤트로픽 사이가 아니라 앤트로픽 내부에서도 정하고 있었다.

그렇다면 AI 기업의 책임은 어디서 시작하는가?

흔한 반론은 이렇다. 총기 제조사가 살인에 책임 없듯 AI 기업도 군대의 타격 결정에 책임 없다고 할 수 있겠다. 그러나 이 비유는 틀렸다. 총은 목표물을 고르지 않는다. 메이븐-클로드 시스템은 타격 후보를 스스로 생성하고 우선순위를 매긴다. 도구의 성격이 근본적으로 다르다.

2025년 10월 학술지 Ethics and Information Technology에 실린 논문은 이 핵심을 짚는다. "AI 무기 시스템에 관한 논의 대부분이 '시스템이 문제를 일으킨 그 순간'에만 집중한다. 그러나 책임은 설계 단계에서 이미 시작된다." 앤트로픽이 두 가지 금지선을 그은 것은 그 설계 단계의 책임을 인식한 행위다. 완벽하지 않고 그 선을 지금도 재협상 중이라 하더라도 선을 그으려 한다는 것 자체가 팔란티어의 '우리는 도구일 뿐'과는 다른 출발점이다.

트럼프식 AI 무기화가 어리석은 세 가지 이유

트럼프 행정부의 AI 전략을 윤리가 아니라 순수하게 전략적 관점에서만 봐도 문제투성이다.

첫째, 전시에 핵심 시스템을 뜯어고치는 자충수다. 앤트로픽을 공급망 위험 업체로 지정했다고 해서 지금 사용중인 메이븐 시스템에서 클로드를 빼는데는 최대 18개월이 필요하다. 펜타곤 IT 계약업체들은 이 결정을 대놓고 "멍청한 짓(stupid)"이라고 불렀다. 전쟁이 벌어지는 동안 핵심 타격 지원 시스템의 두뇌를 갈아끼우겠다는 것이다. 적보다 자신이 더 효과적으로 자국 전투력을 약화시키는 방법이다.

둘째, 틀릴 수 있는 시스템으로 전쟁을 하는 위험이다. 앤트로픽 CEO 다리오 아모데이는 직접 인정했다. "우리가 만드는 시스템이 완벽하게 신뢰할 수 있다고 100% 보장할 수 없다."

이란 초등학교 타격 사건에서 전문가들은 AI 시스템이 학교 옆 IRGC 시설과의 경계를 구분하지 못했을 가능성을 제기했다. 위성 이미지로 13년 전부터 확인 가능했던 그 경계벽을. 단, Semafor 보도는 이 타격의 직접 원인이 AI가 아니라 인간 정보 분석의 오류였을 가능성을 더 높게 본다. AI의 역할은 아직 공식 확인되지 않았다. 어느 쪽이든 문제의 구조는 같다. 신뢰 한계가 검증되지 않은 시스템으로 24시간 안에 1,000개, 3주 만에 6,000개에 가까운 타격 좌표를 찍어내는 것은 효율로 따질 문제가 아니다.

셋째, 억지 자체를 망가뜨린다. 전략 이론가 토마스 셸링(Thomas Schelling)은 억지가 작동하려면 상대가 내 의도를 읽을 수 있어야 한다고 했다. 신호를 보내고, 상대가 그것을 해석하고, 그래서 확전이 멈춘다. 이 기제가 냉전 시대 핵전쟁을 막아온 논리다.

그런데 AI 타격 시스템은 의도를 신호로 보내지 않는다. 미국이 AI 시스템으로 3주 동안 6,000개에 가까운 이란 시설을 타격할 때, 이란 입장에서는 이것이 전면전 선언인지 알고리즘 오작동인지 협상용 압박인지 구별할 방법이 없다. 억지가 작동하는 공간이 사라진다. 가드레일 없는 AI 무기화는 오히려 확전을 통제 불가능하게 만든다. 학술 연구는 이미 이 문제를 명시했다. 자율 시스템은 맥락에 적응하지 않고 미리 프로그래밍된 프로토콜을 실행하기 때문에, 셸링이 전제하는 억지의 가능성 자체를 흔든다.

책임은 어디에 있는가

팔란티어의 진짜 위험은 나쁜 결과가 아니라 구조에 있다. 이란 미나브 초등학교 인근에 미사일을 보낸 팔란티어 엔지니어, 그 시스템을 승인한 국방부 조달 담당자, 최종 버튼을 누른 군 지휘관, 시스템 도입을 명령한 행정부, 클로드를 팔란티어에 라이선스한 앤트로픽. 모두 이 사슬로 연결되어 있다. 그런데 현행 국제 규범은 이 분산된 구조에서 누구에게 책임을 물어야 하는지 아직 답을 갖고 있지 않다.

샴 상카가 "투표함과 법정이 작동하고 있다"고 말할 때, 그는 이 공백을 정확히 이용하고 있다. 기술은 실행하고 책임은 시스템이 진다. 그 시스템이란 결국 아무도 아니다.

하지만 이 구조를 만든 것은 팔란티어 혼자가 아니다. 속도를 책임보다 앞세운 트럼프 행정부, 금지선을 그으면서도 드론 군집 제안서를 냈던 앤트로픽, 그리고 AI 무기 시스템에 관한 국제 규범을 여전히 완성하지 못한 국제사회. 팔란티어는 이 구조의 가장 적극적인 실행자일 뿐이다.

미나브 초등학교에 미사일이 떨어진 이유가 AI의 오작동이든 인간의 오판이든, 책임이 누구에게 있냐는 질문은 사라지지 않는다. 이 구조를 가능하게 하는 인센티브는 누가 만들었고 그 비용은 누가 치르는가. 알고리즘은 이 질문에 답하지 않는다. 그러므로 AI가 아무리 발달해도 최종 결정은 사람이 해야 하는 구조를 만들어야 한다. 그래야 무책임한 살인을 막을 수 있기 때문이다.