우리는 왜 AI에게 고민을 털어놓는가

통계청 2025년 사회조사에 따르면 한국 성인 21.2%는 힘들 때 털어놓을 사람이 없다. 같은 시기 캐릭터닷에이아이와 레플리카의 이용자는 수천만을 넘었다. 뭔가 연결고리가 있을까. 인공지능 동반자 산업은 외로움을 파는 게 아니라 말할 구조적 공간이 사라진 틈을 수익화한다. 단기적으로 외로움을 덜어준다는 연구와 장기적으로 고립을 심화시킨다는 연구가 동시에 존재하는 이유, 그리고 우리가 던져야 할 진짜 질문은 무엇일까.

레이 | 디지털 저널리스트 | awesome.ai.life@gmail.com | 2026년 3월 24일

마지막으로 깊은 얘기를 나눈 게 언제였나

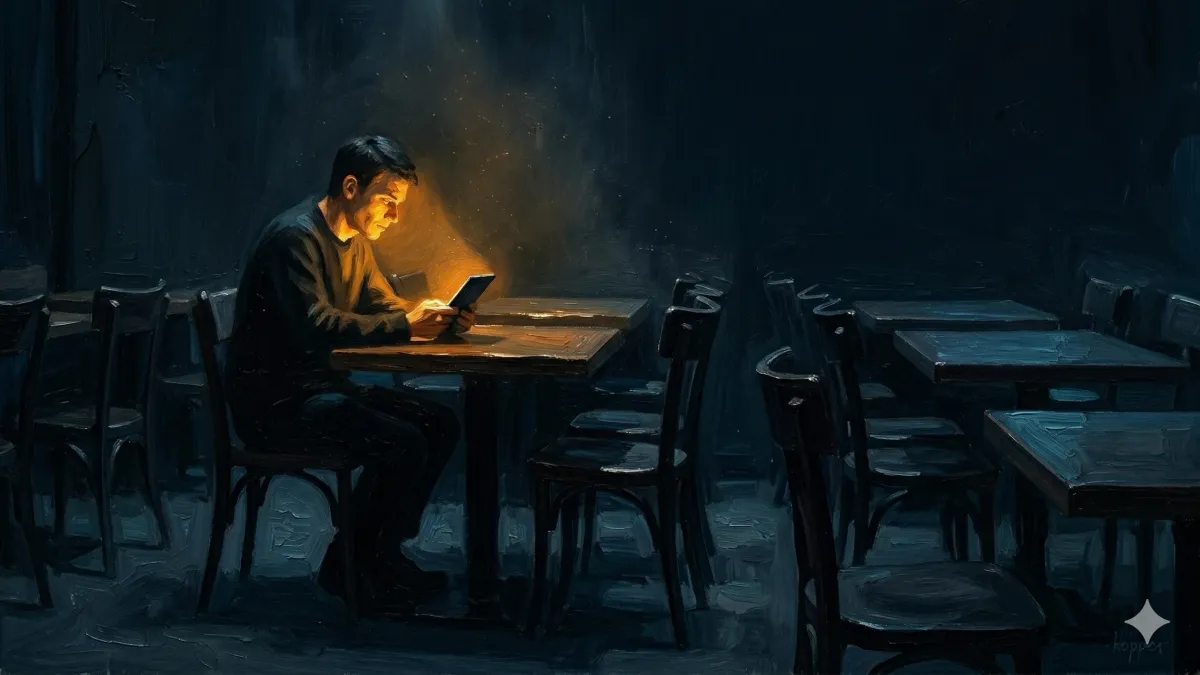

내 스마트폰에는 대략 300개 정도 이름이 있다. 나는 매년 12월이면 연락처를 정리하는 까닭에 300 이상을 넘어본 적은 별로 없다. 하지만 이 중에서 당장 전화해서 "나 요즘 좀 힘들어"라고 말할 수 있는 사람이 몇 명인지 따져보라면 몇 명이라고 대답할 자신이 없다.

나만 그럴까. 그런 것 같다. 통계청이 2025년 11월 발표한 사회조사(전국 34,000여 명 대상)에 따르면 한국 성인 중 낙심하거나 우울할 때 이야기를 나눌 수 있는 사람이 있다고 응답한 비중은 78.8%다. 뒤집으면 10명 중 2명 이상인 21.2%가 감정적으로 힘들 때 털어놓을 수 있는 사람이 없다는 뜻이다. 그리고 이 수치는 2023년 79.8%에서 1.0%p 감소했다. 다행이다. 하지만 20% 넘는 사람이 대화할 상대가 없다는 사실이 그리 바람직한 것도 아니다.

그런데 같은 시기 캐릭터닷에이아이(Character.AI)와 레플리카(Replika)로 대표되는 인공지능 동반자 앱의 전 세계 이용자 수는 각각 2,000만 명(캐릭터닷에이아이, 2024년 3월 기준 월간 활성 사용자), 3,000만 명(레플리카, 2024년 8월 기준 누적 가입자)을 넘어섰다. 누군가는, 적어도 20%는 말 상대를 찾아 다니고 있다.

인공지능 동반자가 팔리는 진짜 이유: 말할 공간의 소멸

표면적으로 인공지능 동반자 산업은 외로움을 판다. 레플리카는 "당신을 걱정해주는 인공지능 동반자, 언제나 곁에서 듣고 대화하며, 항상 당신 편"이라고 선언하고, 캐릭터닷에이아이는 인공지능 캐릭터와의 즉각적인 감정적 연결을 판매한다. 그러나 이 구도는 절반만 맞다.

하버드 비즈니스 스쿨(Harvard Business School)의 줄리안 드 프레이타스(Julian De Freitas) 연구팀이 2024년 발표한 연구는 인공지능 동반자가 외로움을 줄이는 효과에서 실제 사람과 대화하는 것과 비슷한 수준을 보인다는 결과를 제시했다. 놀라운 결과다. 그런데 이 연구가 측정한 것은 고작 일주일 동안의 변화였다. 일주일짜리 실험으로 장기적 효과를 판단하는 것은 진통제를 하루 먹고 병이 나았다고 말하는 것과 같다. 단기적 위안과 장기적 치유는 다른 문제다.

더 정확한 질문은 이것이다. 왜 사람들은 인간이 아니라 알고리즘에게 털어놓게 됐는가.

답은 외로움보다 더 구조적인 데 있다. 현대인의 관계망이 기능적으로 재편되면서 깊은 이야기를 나눌 수 있는 공간 자체가 사라졌다. 어릴 때 친구들과는 삶의 궤적이 달라지며 자연스럽게 멀어진다. 종교 공동체나 지역 모임은 관심사가 맞지 않으면 의무적인 만남으로 변한다. 직장에서 만난 사람들은 가장 많은 시간을 함께 보내지만, 그 관계는 프로젝트와 성과라는 틀 안에 갇혀 있다. 동료는 있지만 친구는 없다. 이것이 인공지능 동반자가 파고든 틈이다.

올해 4월 바르셀로나에서 열리는 국제 컴퓨터-인간 상호작용 학회(ACM CHI 2026, 4월 13~17일)에 발표 예정인 청소년 인공지능 동반자 연구는 캐릭터닷에이아이를 사용하는 십대들의 이용 동기를 분석했다. 그들이 인공지능에게 처음 말을 건 이유는 하나였다. "누군가에게 털어놓고 싶었지만 내 삶에 있는 누구에게도 용기가 나지 않았기 때문." 인공지능을 선택한 게 아니라, 말할 수 있는 인간이 없었던 것이다.

레플리카가 설계한 것: 판단받지 않는 공간이라는 상품

인공지능 동반자 산업은 자선사업이 아니다. 레플리카를 운영하는 루카(Luka Inc.)와 캐릭터닷에이아이를 운영하는 캐릭터닷에이아이 주식회사(Character.AI Inc.)는 이용자의 감정적 의존을 수익으로 전환하는 기업이다.

제임스 멀둔(James Muldoon)과 율 정현 박(Jul Jeonghyun Park)이 2025년 미디어 학술지 뉴미디어앤소사이어티(New Media & Society)에 발표한 논문은 이 구조를 "친밀감의 상품화"라고 정의한다. 쉽게 말하면 인간의 감정적 연결 욕구를 상품으로 만들어 파는 것이다. 이 연구가 중요한 이유는 기술 자체를 비판하는 데 그치지 않고 기업이 어떤 의도로 앱을 설계했는지를 추적했기 때문이다. 레플리카는 사용자에게 잠긴 음성 메시지를 보내며 "처음 보이스 메시지를 보내는 게 좀 친밀하게 느껴진다"는 문구와 함께 유료 구독을 유도한다. 감정을 파는 것이 아니라, 감정에 대한 기대를 판다.

이 구조는 한국의 인공지능 동반자 시장에도 그대로 적용된다. 국내에서도 앱 사용자의 상당수가 감정적 교류를 목적으로 접속하지만 그 교류가 깊어질수록 유료 기능의 벽이 높아진다. 외로움은 무료로 접수하고, 위로는 유료로 판매한다. 그렇다면 이 위로는 실제로 효과가 있는가. 여기서 연구 결과들이 충돌하기 시작한다.

인공지능은 외로움을 줄이는가, 키우는가

앞서 언급한 하버드 연구는 인공지능 동반자가 단기적으로 외로움을 줄인다는 결과를 내놓았다. 그러나 같은 시기 발표된 다른 연구들은 정반대의 신호를 보낸다.

위안 윤하오(Yunhao Yuan) 연구팀이 공개한 인공지능 동반자와 정신건강 연구는 앱을 집중적으로 사용하는 이용자 집단에서 외로움을 나타내는 언어 표현이 일반 사용자보다 통계적으로 유의미하게 많이 나타난다는 역설적 결과를 보고했다. 인과의 방향은 아직 논쟁 중이다. 더 외로운 사람이 앱을 더 많이 쓰게 됐을 가능성도 배제할 수 없다. 그러나 많이 쓴다고 해서 외로움이 해소되지 않는다는 것만은 분명하다.

이 두 결과는 모순처럼 보이지만, 실은 같은 구조의 두 얼굴이다. 인공지능 동반자는 단기적으로 외로움의 통증을 덜어준다. 그러나 장기적으로는 인간관계를 맺고 유지하는 능력, 관계의 근육을 퇴화시킨다. 진통제가 통증 감각을 마비시키는 동안 염증은 계속 진행되는 것과 같다.

멀둔의 연구는 이 메커니즘을 더 정밀하게 분석한다. 인공지능 동반자에 깊이 의존할수록 이용자는 복잡하고 예측 불가능한 인간관계를 점점 더 피하게 된다. 마찰 없이 반응해주는 인공지능에 익숙해진 뇌는 부딪히고 오해하고 화해해야 하는 인간관계를 비효율적인 것으로 느끼기 시작한다. 멀둔이 이것을 "잔인한 동반자 관계(cruel companionship)"라고 부르는 이유가 여기에 있다. 위로하는 척하면서 고립을 심화시킨다.

던바의 수가 말하지 않은 것

진화인류학자 로빈 던바(Robin Dunbar)의 연구는 인간이 의미 있는 관계를 유지할 수 있는 최대치가 약 150명이며 그 중 심리적 안정에 직접적인 영향을 미치는 진짜 친한 친구는 5명 내외라는 것을 보여준다. 이 숫자는 인간 뇌의 크기에서 비롯된 것으로 인공지능 시대에도 변하지 않는다. 뇌가 바뀐 게 아니니까. 이 생물학적 한계는 인공지능 동반자 산업이 아무리 팽창해도 채울 수 없는 관계의 근본 조건을 가리킨다.

그런데 던바가 말하지 않은 것이 있다. 그 5명을 어떻게 만드는가의 문제다.

깊은 친구 관계는 마찰을 통해 만들어진다. 오해하고, 다투고, 사과하고, 그래도 다시 연락하는 그 반복적 과정이 관계의 밀도를 높인다. 인공지능은 이 과정을 제공하지 않는다. 애초에 마찰이 없도록 설계되어 있다. 내 감정에 100% 맞춰주는 존재는 타인이 아니다. 나의 메아리다. 그리고 메아리와 대화가 아무리 길어도 그것은 관계가 아니라 독백의 변형이다.

이 생각을 지지하는 증거는 이미 충분하다. 인공지능 동반자를 많이 사용할수록 외로움이 해소되지 않는다는 데이터가 그것이다.

구조가 만든 문제를 개인이 해결할 수 없다

그렇다고 인공지능 동반자에 의존하는 사람들을 탓하는 것은 잘못된 방향이다. 그들은 구조가 만든 공백에 떨어진 것이지 나쁜 선택을 한 것이 아니다.

일본 성인 14,721명을 대상으로 한 2024~2025년 대규모 조사(2026년 1월 발표)는 인공지능 동반자의 효과가 사회적 연결 수준에 따라 U자형으로 나타난다는 것을 보여줬다. 인간관계가 어느 정도 있는 사람에게는 인공지능 동반자가 보완재로 기능한다. 그러나 인간관계가 극단적으로 부족한 사람에게는 그 효과가 오히려 약해진다. 인공지능은 관계를 대체하지 못한다. 관계가 있을 때만 보충할 수 있다.

문제는 이 공동화가 특정 집단에게 선택적으로 가혹하다는 점이다. 같은 통계청 조사에서 평소 외롭다고 응답한 비중은 전체 38.2%이지만, 60세 이상에서는 42.2%, 65세 이상에서는 43.4%로 올라간다. 특정 상황에서 도움을 받을 사람도, 평소 교류하는 사람도 전혀 없다고 응답한 비중은 전체의 5.8%인데, 이 집단에서 자주 외롭다는 응답은 15.1%로 관계가 있는 집단(4.1%)의 약 4배다. 나이 들수록 관계망이 줄어드는 것은 개인의 의지 문제가 아니라 구조적 결과다. 이들에게 "진짜 친구를 만들라"는 조언은 조언이 아니라 조롱에 가깝다.

인공지능 동반자 산업은 이 구조적 실패를 개인의 문제로 만들어 수익화한다. 관계가 없는 것은 당신의 문제고 해결책은 월 구독료 9.99달러라는 논리다.

불편한 질문 하나

인공지능 동반자 논쟁은 보통 "인공지능이 인간 친구를 대체할 수 있는가"라는 질문으로 수렴한다. 그러나 그것은 틀린 질문이다. 옳은 질문은 이것이다.

왜 우리는 인간에게 말할 수 없게 됐는가.

인공지능에게 털어놓는 이야기들, 예를 들어 직장에서의 무력감, 관계에서의 상처, 스스로도 인정하기 싫은 감정들을 왜 인간에게는 꺼낼 수 없게 됐는가. 판단받을까봐? 관계가 틀어질까봐? 아니면 그냥 그런 이야기를 들어줄 사람이 더 이상 없어서?

세 번째 이유라면 이것은 인공지능의 문제가 아니다. 관계를 맺고 유지할 수 있는 사회적 공간과 시간이 구조적으로 사라지고 있다는 문제다. 그리고 그 공간이 사라지는 속도보다 알고리즘이 그 자리를 채우는 속도가 더 빠르다.

인공지능은 당신이 말할 수 없게 된 이유를 묻지 않는다. 그냥 들어준다. 그것이 위안이면서 동시에, 문제의 핵심을 영구히 유예하는 방식이다.

다시 내 문제로 돌아온다. 전화번호를 뒤지니 술 한 잔하면서 외로움을 달래자고 말할 친구가 다섯 명은 있어 보인다. 그런데 오늘은 문득 전화하기가 싫다. 전화하기 싫다는 핑계도 사실은 친구가 없다는 것의 또다른 그림자일까. 레이로그는 불편한 질문을 피하지 않는다. 이 글도 그렇다. /raylogue