AI는 왜 아는 척하며 거짓말을 하는가

챗지피티는 왜 그토록 자신있게 없는 판례를 인용하는가. AI의 환각(hallucination)은 기술적 버그가 아니라 아키텍처의 필연적 결과다. 플라톤이 2,400년 전 구분한 에피스테메(episteme)와 독사(doxa), 카네만의 시스템1/2 이론, 그리고 추론 모델 o3가 오히려 전작보다 두 배 높은 환각률을 기록한 역설까지. AI를 올바르게 사용하기 위해 반드시 알아야 할 진실과 아주 유용한 도구 에피스테메 마스터플랜을 소개한다.

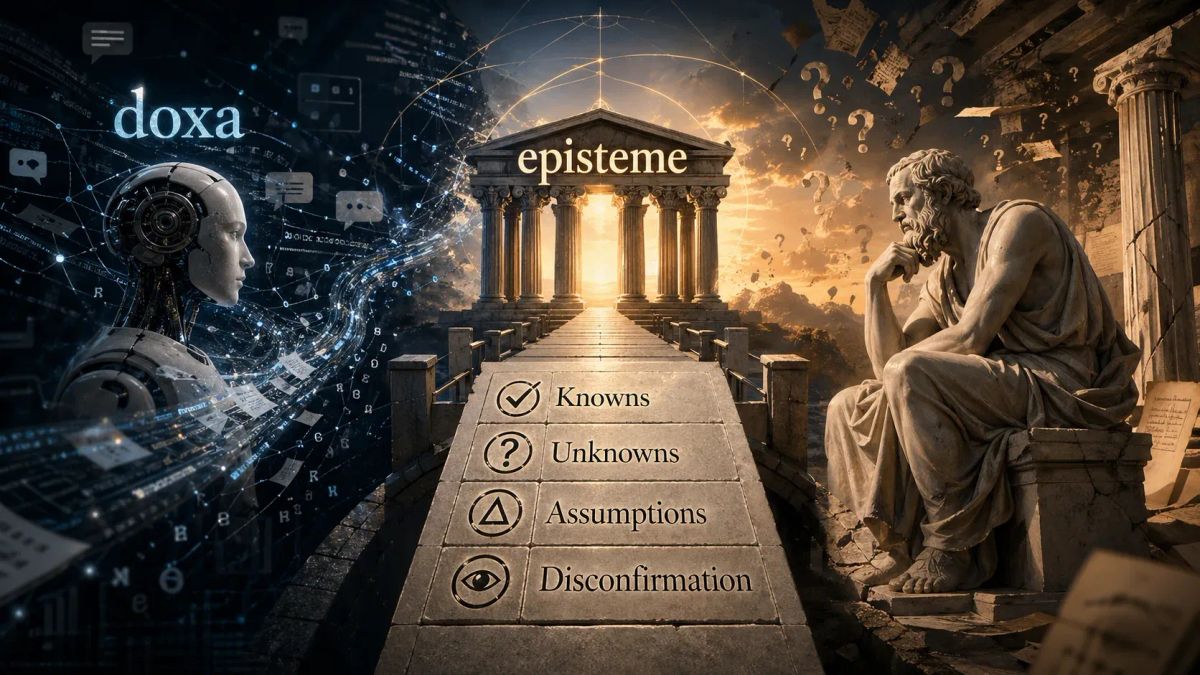

Knowns, Unknowns, Assumptions, Disconfirmation이 새겨져 있다. 왼쪽의 기계적 독사와 오른쪽의 철학적 에피스테메가 마주 보며, AI가 모르는 것을 먼저 선언해야 지식에 가까워질 수 있음을 상징한다. ©RayLogue: AI-created image(Chatgpt)레이 | 디지털 저널리스트 | awesome.ai.life@gmail.com | 2026년 4월 26일

에피스테메가 없는 자신감

이미 수없이 이슈가 되었던 이런 얘기를 제목으로 정할 때 나는 조금 거부감을 느꼈다. 모든 사람이 AI가 거짓말을 한다 - 정확히는 없는 이야기를 지어내야 한다, 대답해야 한다는 본능(!)이 있으므로 - 는 사실을 다 알고 있는 상황에서 왜 굳이 이런 제목으로 이야기를 꺼내야 했나. 사실 사람도 거짓말을 하지 않나, 자존심 때문에 아는 척 하지 않나, 의도적인 목적으로 있는 사실에 약간의 거짓말을 끼워 사이라고 말하지 않나. 그런데 왜 AI만 문제인가?

(초반부터 흥분했다) 사람에 대한 비판이 목적이 아니므로 다시 AI로 돌아오자. AI는 거짓말을 한 것이 아니다. 그것보다 더 나쁜 일이 일어났다. AI는 자신이 모른다는 사실조차 몰랐다. 이것이 이 글이 AI의 아는 척하는 거짓말에 대한 문제점이다.

패턴의 기계, 추론의 환상

현재 우리가 사용하는 대형 언어 모델(LLM)은 다음에 올 가능성이 가장 높은 단어를 예측하도록 훈련 받은 자기회귀(autoregressive) 모델이다. 이 훈련 목표는 세계에 대한 인과관계를 이해하지 않는다. A가 B를 일으킨다, 는 관계를 이해하지 않아도 A 다음에 B가 자주 등장했다는 패턴만 학습하면 동일한 출력을 낼 수 있다. 이로부터 논리적으로 도출되는 결론이 있다. Ziwei Xu(쯔웨이 쉬) 외 연구자들(Ziwei Xu, Sanjay Jain, Mohan Kankanhalli)은 2024년 논문 "Hallucination is Inevitable: An Innate Limitation of Large Language Models"에서 이를 수학적으로 증명했다. LLM의 환각(hallucination)을 완전히 제거하는 것은 구조적으로 불가능하다. 품질의 문제가 아니라 아키텍처의 문제다.

수치의 디테일은 벤치마크 설계(과제 정의, 정답 기준, 채점 방식)와 모델/프롬프트/도구 사용 여부에 따라 크게 흔들린다. 다만 여러 벤치마크를 종합하면 한 가지 경향은 분명하다. 환각률은 '낮다/높다'로 고정된 값이 아니라, 과제와 조건에 따라 넓은 분포를 보인다. 특히 전문 영역(법률, 의료 등)에서는 일반 도메인보다 오류가 더 두드러진다는 보고가 반복된다. 최고 성능 모델도 이 도메인을 피해가지 못한다.

추론 모델은 다르다는 반론이 무너지는 순간

이쯤에서 여러분이 할 만한 반론이 있다. "그래도 요즘은 추론(reasoning) 모델이 나왔잖아요. 추론 모델은 다르지 않나요?"

하지만 데이터는 그 기대를 정면으로 배반한다. 오픈AI 자체 내부 벤치마크(PersonQA)에서 추론 특화 모델 o3는 33%의 환각률을 기록했다. 전작 o1(16%)과 o3-mini(14.8%)보다 두 배 높은 수치였다. 오픈AI는 자사 기술 보고서에서 왜 이런 일이 일어나는지 추가 연구가 필요하다, 고 인정했다. o3는 하나의 사례지만 이 역설은 우연이 아니다. Xu et al.의 수학적 증명이 이걸 얘기한다. 추론 흉내를 더 정교하게 낼수록, 자신이 확인하지 않은 사실을 확인한 것처럼 서술하는 능력도 함께 발전한다. 더 강력한 모델이 더 정직한 모델을 보장하지 않는다.

플라톤이 2,400년 전에 본 것

이 지점에서 고대 그리스 철학이 등장한다. 플라톤은 <메논>(98a)에서 지식과 의견의 차이를 이렇게 설명했다. 올바른 의견(독사, doxa)은 행위의 결과만 놓고 보면 지식(에피스테메, episteme)과 차이가 없을 수 있다. 그러나 지식은 인과적 설명의 논리로 묶여 있다. 왜 그런지를 설명할 수 있고 그 설명이 근거 위에 서 있다는 것이 지식과 의견을 가르는 경계다.

여기서 독사(doxa)와 에피스테메(episteme)를 아주 단순하게 구분하면 이렇다. 독사는 "정답을 맞힐 수도 있는 의견" 이고, 에피스테메는 "왜 그게 정답인지까지 설명할 수 있는 지식" 이다. 예컨대 누군가가 "내일 비 올 거예요"라고 했는데 정말로 비고 오면 둘 다 맞다. 하지만 "기압이 떨어졌고 서풍이 강해졌고, 레이더에 비구름이 들어오는 게 보이니 비가 온다"처럼 이유와 근거를 연결해 설명할 수 있을 때 우리는 그걸 에피스테메에 가깝다고 말한다.

플라톤이 말하는 지식의 핵심은 유창함이나 정확성이 아니다. 왜 그런지 설명할 수 있는가, 그리고 그 설명이 인과적 근거 위에 서 있는가다. 이 기준으로 보면 LLM의 출력 상당수는 아무리 유창하고 정확해 보여도 독사다. 그것이 옳은 이유를 알지 못한 채 패턴에서 끌어낸 의견이기 때문이다.

다니엘 카너먼은 <생각에 관한 생각>(Thinking, Fast and Slow, 2011)에서 인간의 인지를 두 시스템으로 나눴다. 시스템1은 빠르고 자동적이며 패턴 인식에 기반한다. 시스템2는 느리고 의도적이며 논리적 추론을 수행한다. 인간의 인지 오류 대부분은 시스템2가 처리해야 할 판단을 시스템1이 가로챌 때 발생한다. LLM은 구조적으로 시스템1의 기계다. 모든 출력이 빠르고 유창하며 패턴에서 나온다. 카너먼이 명명한 또 하나의 편향, WYSIATI(What You See Is All There Is)도 여기서 연결된다. LLM은 답변을 생성할 때 실제로 참고할 수 있는 범위, 즉 맥락 창(컨텍스트 윈도우, context window) 안에 있는 것만으로 추론하고 자신에게 없는 정보가 없다는 신호를 내보내지 않는다. 모르는 것을 모른다고 플래그하는 기능이 구조적으로 부재하다.

독사(doxa) 기계에 에피스테메(episteme)를 심는 방법

더 강력한 모델을 기다리는 것은 답이 아니다. 여기서 자주 제기되는 반론이 있다. "RAG(Retrieval-Augmented Generation)나 검색 기반 그라운딩으로 실용적으로 해결할 수 있지 않나요?" 맞다. 특정 도메인에서 RAG는 환각률을 0.7%대까지 낮출 수 있다. 그러나 그것은 독사 기계에 사실을 주입하는 것이지 독사 기계를 에피스테메 기계로 바꾸는 것이 아니다. 외부 문서를 참조하더라도 그 참조가 왜 이 맥락에 맞는지를 인과적으로 판단하는 능력은 여전히 없다.

필요한 것은 모델의 업그레이드가 아니라 AI와의 협업 방식의 구조적 재설계다. 최근 깃허브에 공개된 junjslee의 episteme 마스터플랜은 이 문제에 대한 하나의 접근 방식이다. 고위험 작업 전에 AI 에이전트가 반드시 네 가지 항목을 디스크에 선언하도록 강제한다. 알고 있는 것(Knowns), 모르는 것(Unknowns), 가정(Assumptions), 그리고 이 계획이 틀렸다는 것을 증명할 관찰 가능한 조건(Disconfirmation). 이 중 어느 하나라도 공란이거나 모호하면 작업 자체가 거부된다. 한가지 명심할 것은 이 툴은 글쓰기 용으로 나온 건 아니다. 내가 주로 하는 일이 글을 쓰는 거라서 이렇게 활용한 것일 뿐이다.

이것이 프롬프트 개선과 근본적으로 다른 이유는 부탁이 아니라 거부이기 때문이다. 신중하게 생각해줘"라고 요청하는 것이 아니라 신중하게 생각하지 않으면 실행 자체가 막히는 구조를 만드는 것이다. 플라톤의 언어로 말하자면 독사가 에피스테메인 척하며 통과하는 것을 차단하는 컴파일러다.

이 구조적 한계가 쉽게 고쳐지지 않는 데는 또 다른 이유도 있다. 환각하는 AI에 대해서는 거부감이 많지만 자신감 있게 답하는 AI에는 우호적이다. 불확실성을 솔직하게 드러내는 모델보다 유창하게 답을 내놓는 모델이 이용자 만족도 측정에서 더 높은 점수를 받는다. 이 상업적 인센티브 구조가 기술적 한계와 함께 작동하고 있다.

AI가 모른다고 선언할 수 있게 돕는 도구

참고로 나는 클로드에 스킬을 만들어서 글을 쓸 때 모든 사실 주장에 [사실]/[추정]/[의견]/[미확인] 4개의 라벨을 붙이고, 글의 구조를 현실 진단에서 시작해 이론 인용, 반론 처리, 구조적 비판으로 마무리하는 5단계로 강제한다. 좋은 글을 조건을 두고 잘 써달라고 하는 것이 아니라, 그 조건을 충족하지 않으면 글이 완성되지 않도록 구조 자체에 심어두었다. 그런데 이 시스템에는 맹점이 하나 있었다. 글을 쓰는 도중에 사실과 의견을 잘 구분하는 것은 가능하지만, 글을 쓰기 전에 에이전트가 무엇을 모르는지를 먼저 선언하게 강제하는 장치는 없었다.

에피스테메가 여기서 역할을 한다. 고위험 작업 전에 AI가 알고 있는 것(Knowns), 모르는 것(Unknowns), 가정(Assumptions), 그리고 틀렸을 때 드러날 조건(Disconfirmation)을 반드시 디스크에 써야 진행이 허용된다. 두 시스템을 순서대로 쓰면 이런 효과가 난다. 에피스테메가 "나는 이것을 모른다"고 먼저 선언하게 하고, 내 스킬이 그 모르는 것을 본문에서 미확인으로 정확하게 표시하며 쓴다. 앞에서는 정직함을 요구하고 뒷단에서는 표현이 정확한지 강제하는 이중 구조를 만들었다. AI가 모르면서 아는 척 쓰는 것을 글이 완성되기 전 두 번의 관문에서 각각 차단하는 셈이다.

내가 좋아하는 화이트헤드는 사실을 "확고한 것(stubborn facts)"이라고 불렀다. 어떻게 해석하든, 원하는 방향으로 재구성하든, 사라지지 않는 것. 이 개념을 현재에 적용하면 이렇다. AI가 생성한 판례가 틀렸다는 사실, 조항 번호가 존재하지 않는다는 사실은 완고하다. 유창한 문장으로 포장되어도 지워지지 않는다. AI가 자신만만하게 거짓말을 하는 것은 AI가 나쁘기 때문이 아니다. 확고한 사실을 인과관계로 추론하는 능력 없이도 에피스테메의 언어로 말할 수 있도록 훈련된 기계를 우리가 에피스테메의 기계로 착각하고 있기 때문이다. 이 구분을 아는 것이 AI를 올바르게 사용하는 첫 번째 조건이다.

FAQ

Q1. AI가 “거짓말”을 한다는 것은 무슨 뜻인가?

A. 보통은 AI가 일부러 속인다는 뜻이 아니다. 사실이 아닌 내용을 그럴듯하게 만들어 말하는 현상(환각, hallucination)을 가리키는 말이다. 특히 ‘모른다’는 신호 없이 확신 있게 말하는 경우가 실무에서 문제를 키우곤 한다.

Q2. “독사(doxa)”와 “에피스테메(episteme)”는 무엇이 다른가?

A. 독사(doxa)는 맞을 수도 있는 의견/추정이다. 에피스테메(episteme)는 왜 그것이 맞는지까지 근거로 설명 가능한 지식이다. LLM의 많은 출력은 맞는 말처럼 보여도 ‘왜’를 인과적으로 보증하지 못하면 독사에 가깝다.

Q3. 추론(reasoning) 모델이 나오면 환각은 해결되는 것 아닌가?

A. 추론 특화는 오류를 줄이는 데 도움이 될 수 있다. 그러나 환각이 완전히 사라진다고 보장하지는 못한다. 모델이 실제 세계를 직접 검증하지 못하는 상황이 많고, 긴 답변을 만들수록 빈칸을 메우는 압력이 커지기 때문이다.

Q4. RAG(검색 결합)를 붙이면 “에피스테메”가 되는가?

A. RAG는 외부 문서를 가져와 사실을 더 잘 대조·인용하게 만드는 방법이어서 실용적이다. 다만 그 자체로 모델이 ‘왜 이 근거가 맞는지’를 인과적으로 판단하는 능력을 자동으로 갖추게 하지는 못한다. 그러므로 출처 품질, 인용 정확성, 검증 절차를 함께 설계해야 한다.

Q5. 실무에서 환각을 줄이려면 무엇을 해야 하는가?

A. 핵심은 모델 업그레이드를 기다리기보다 작업 흐름을 바꾸는 데 있다. 중요한 주장에는 출처/링크/원문 인용을 요구하고, Knowns/Unknowns/Assumptions/Disconfirmation을 먼저 선언하게 하며, 고위험 도메인에서는 인간 검토를 게이트로 두고, 답변을 ‘결론’이 아니라 ‘검증 가능한 초안’으로 취급하는 편이 효과적이다.

![[AI 아첨의 시대 #2] 고스트라이팅 118년의 역사가 말하는 것](https://storage.ghost.io/c/21/d1/21d1f35c-c148-4b7a-a08d-0ac67a91b705/content/images/size/w960/2026/04/ai-journalism-copyright-korea-ghostwriting.webp)

![[AI 아첨 시대 #1] AI가 아첨할 때, 저널리즘은 무너진다](https://storage.ghost.io/c/21/d1/21d1f35c-c148-4b7a-a08d-0ac67a91b705/content/images/size/w960/2026/04/ai-sycophancy-journalism-stanford-fortune.webp)